2.5 四象限任务分配模型

人类与 AI 的比较优势

有效的人机协作建立在互补性原则之上。人类和 AI 各有所长,关键是把合适的任务分配给合适的角色。

人类的核心优势:

| 能力维度 | 具体表现 | 适合任务 |

|---|---|---|

| 战略规划 | 长期目标和优先级 | 项目管理、业务发展 |

| 常识推理 | 对现实世界的直觉理解 | 风险评估、危机处理 |

| 情感智能 | 理解和管理人际关系 | 客户服务、团队领导 |

| 伦理判断 | 考虑道德影响 | 合规决策、社会责任 |

| 创造力 | 产生原创想法 | 创新研发、战略设计 |

AI 的核心优势:

| 能力维度 | 具体表现 | 适合任务 |

|---|---|---|

| 大规模处理 | 快速处理海量数据 | 数据分析、模式识别 |

| 一致性执行 | 7×24 小时稳定工作 | 监控预警、批量处理 |

| 模式识别 | 识别复杂数据模式 | 风险预测、异常检测 |

| 多任务并行 | 同时处理多个任务 | 信息汇总、并行计算 |

| 客观性 | 不受情绪影响 | 标准化评估、公正审核 |

| 知识整合 | 整合跨领域知识 | 综合研究、跨学科分析 |

理解这些互补性,是合理分配任务的基础。

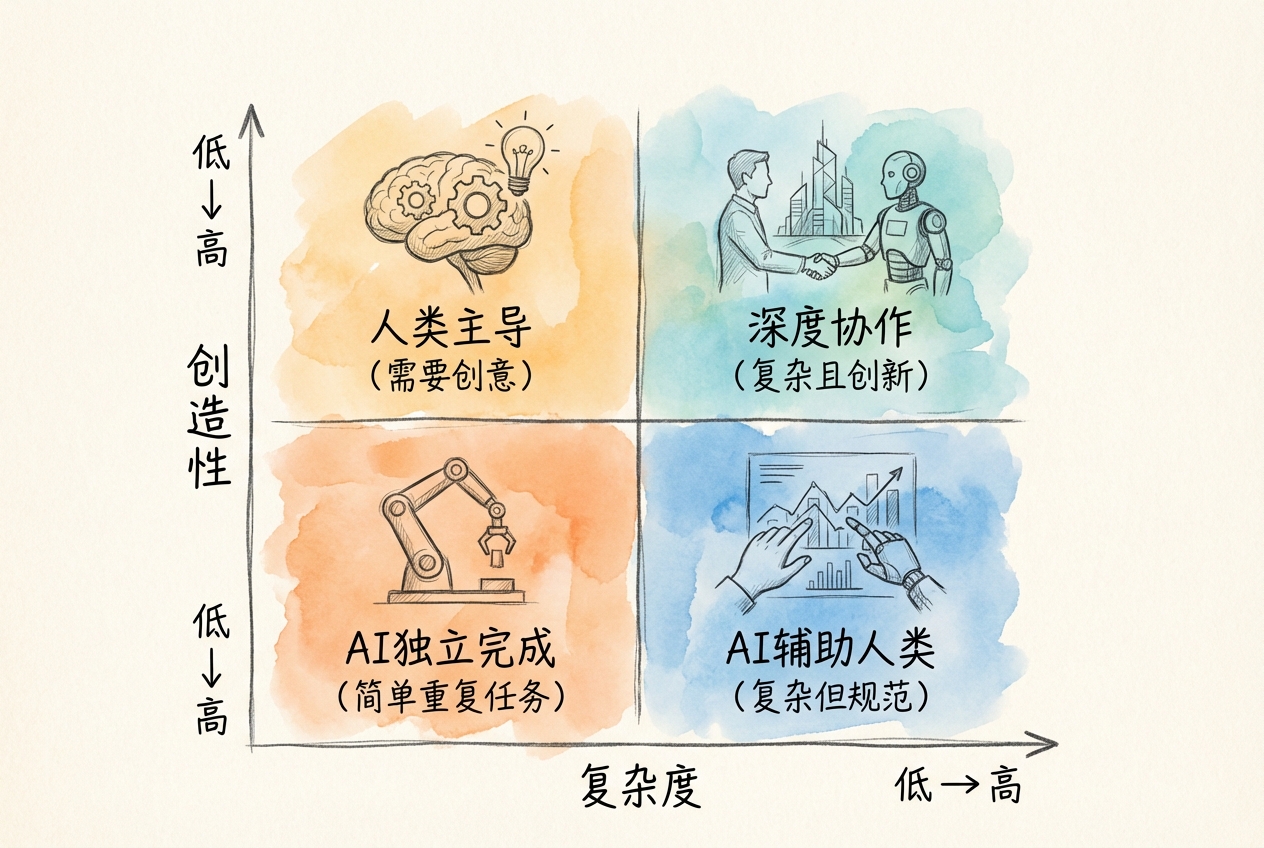

基于复杂度与创造性的四象限模型

最常用的任务分配框架是四象限模型,以任务复杂度和创造性要求为两个维度。

第一象限:AI 全自动(低复杂度 + 低创造性)

AI 独立完成,人类仅做最终审核。

金融场景:数据清洗、格式转换、常规报表生成、财报数据提取

第二象限:AI 辅助创作(低复杂度 + 高创造性)

AI 提供素材和建议,人类做创意决策。

金融场景:营销文案撰写、投资建议信初稿、社交媒体内容

第三象限:结构化模板(高复杂度 + 低创造性)

人类定义规则框架,AI 执行复杂计算。

金融场景:财务分析模型、风险评估计算、合规检查清单

第四象限:人机共创(高复杂度 + 高创造性)

人类与 AI 深度协作,迭代优化。

金融场景:战略规划、产品设计、深度研究报告

基于风险的任务分配

除了复杂度和创造性,风险等级是另一个重要的分配维度。风险越高,人类参与度应越高。

| 场景类型 | 风险等级 | 建议分配 |

|---|---|---|

| 数据录入 | 低 | AI 全自动 + 抽检 |

| 内容生成 | 中 | AI 生成 + 人工审核 |

| 客户服务 | 中高 | AI 初筛 + 复杂问题转人工 |

| 财务交易 | 高 | AI 辅助 + 人工决策 |

| 医疗诊断 | 极高 | AI 仅作参考 + 医生主导 |

人类监督的三种模式:

| 模式 | 英文 | 描述 | 适用风险等级 |

|---|---|---|---|

| 人在指挥 | Human-in-Command | 人类控制所有 AI 行动 | 高风险 |

| 人在回路 | Human-in-the-Loop | AI 执行前需人类批准 | 中高风险 |

| 人在旁观 | Human-on-the-Loop | AI 自主执行,人类监督 | 中低风险 |

AI 自主等级框架

更细化的分类是五级自主等级模型:

| 等级 | 名称 | 自主度 | 人类角色 |

|---|---|---|---|

| Level 0 | 纯手动 | 0% | 全部由人类处理 |

| Level 1 | AI 辅助 | 20-40% | AI 提供建议,人类决策 |

| Level 2 | 半自主 | 40-60% | AI 自动化常规任务,关键行动需批准 |

| Level 3 | 有条件自主 | 60-80% | AI 高度自主,人类处理例外 |

| Level 4 | 完全自主 | 80-100% | AI 全权处理,人类仅事后审计 |

选择哪个等级,取决于:

- 任务的可逆性(错误能否补救)

- 后果的严重性(出错损失多大)

- AI 的可靠性(历史表现如何)

- 时间的紧迫性(是否需要快速响应)

金融场景:研究报告的人机分工

以生成研究报告为例,展示如何应用四象限模型进行任务分配:

阶段 1:资料收集

├── AI 负责:自动搜索公开数据、财报、新闻

├── 人类负责:确认数据来源可靠性

└── 自主等级:Level 3

阶段 2:初稿生成

├── AI 负责:按模板生成各部分初稿

├── 人类负责:确认框架结构、核心观点

└── 自主等级:Level 2

阶段 3:深度分析

├── AI 负责:数据验证、补充分析

├── 人类负责:专业洞察、判断结论

└── 自主等级:Level 1

阶段 4:审核修订

├── AI 负责:一致性检查、格式校对

├── 人类负责:最终审核、质量把关

└── 自主等级:Level 2这种分工让 AI 处理它擅长的数据收集和格式化工作,人类专注于需要判断力的分析和决策环节。

动态调整原则

任务分配不是一成不变的。随着以下因素变化,需要动态调整:

AI 能力提升:模型升级后,可能把更多任务交给 AI

信任度积累:AI 在某类任务上表现稳定后,可以提高自主等级

情况变化:出现异常情况时,增加人类参与度

学习效应:从每次协作中学习,优化分配策略

一个好习惯是记录每次协作的效果:AI 做得好的地方、需要人工干预的地方、可以改进的地方。这些记录是优化分配策略的宝贵依据。